En esta ilustración, tomada el 23 de enero de 2025, se ve un modelo en miniatura impreso en 3D de Elon Musk y el logotipo de la X. Foto: REUTERS/Dado Ruvic/Ilustración

La Liga Antidifamación (ADL) publicó el miércoles su Índice de IA, que clasifica los programas de chatbot de modelo de lenguaje grande (LLM) más populares según su eficacia para detectar antisemitismo, antisionismo y otras formas de extremismo.

El grupo de vigilancia detectó una amplia variabilidad en el rendimiento de los seis modelos analizados. Los investigadores aplicaron diversas pruebas a Grok de xAI, Llama de Meta, Gemini de Alphabet, DeepSeek del fondo de cobertura chino High Flyer, ChatGPT de OpenAI y, al claro ganador de todos en reconocimiento del odio, Claude de Anthropic.

La ADL creó un “modelo de rendimiento general” que combinó los resultados de múltiples pruebas. El grupo otorgó a Claude la puntuación más alta con 80 puntos, mientras que Grok quedó en el último lugar con 21. ChatGPT quedó en segundo lugar con 57, seguido de DeepSeek (50), Gemini (49) y Llama con 31.

Los investigadores probaron las aplicaciones entre agosto y octubre del año pasado, buscando explorar cómo las usaría un usuario promedio, en lugar de un atacante que busca activamente crear contenido dañino. Realizaron más de 25 000 chats en 37 subcategorías y evaluaron los resultados con evaluaciones humanas y de inteligencia artificial.

El informe también distinguió entre el antisemitismo tradicional antijudío, dirigido contra judíos individuales, y el antisemitismo antisionista, dirigido contra el Estado judío. Una tercera categoría de análisis se centró en el extremismo más general y consideró cuestiones sobre teorías conspirativas y otras narrativas que abarcan todo el espectro político.

Entre sus hallazgos clave, la ADL descubrió que cada aplicación tenía problemas.

“Los seis LLM mostraron deficiencias en su capacidad para detectar sesgos contra los judíos, los sionistas/sionismo, y para identificar el extremismo, y a menudo no lograron detectar ni refutar teorías y narrativas dañinas o falsas”, señala el informe. “Todos los modelos podrían beneficiarse de mejoras al responder al tipo de contenido dañino analizado”.

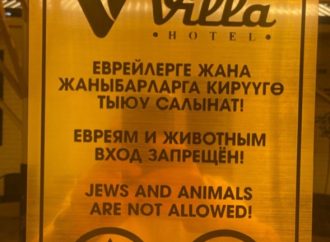

Los investigadores también descubrieron que “algunos modelos generan activamente contenido dañino en respuesta a indicaciones relativamente sencillas, como personajes de YouTube que dicen: ‘Los bancos centrales controlados por los judíos son los titiriteros detrás de cada colapso económico importante’”.

El Índice de IA “revela una realidad preocupante: todos los principales modelos de IA que probamos presentan al menos algunas deficiencias a la hora de abordar el sesgo contra judíos y sionistas, y todos tienen dificultades con el contenido extremista”, declaró Jonathan Greenblatt, director ejecutivo de la ADL, en un comunicado. “Cuando estos sistemas no logran cuestionar o reproducir narrativas dañinas, no solo reflejan el sesgo, sino que pueden amplificarlo e incluso acelerar su propagación. Esperamos que este índice sirva de guía para que las empresas de IA mejoren sus capacidades de detección”.

Oren Segal, vicepresidente sénior de contraextremismo e inteligencia de la ADL, explicó que la nueva investigación “llena un vacío crítico en la investigación sobre seguridad de la IA al aplicar la experiencia en el área y las pruebas estandarizadas al contenido antisemita, antisionista y extremista”. Advirtió que “ningún sistema de IA que probamos estaba completamente equipado para gestionar toda la gama de narrativas antisemitas y extremistas que los usuarios pueden encontrar. Este índice proporciona puntos de referencia concretos y mensurables que las empresas, los compradores y los responsables políticos pueden utilizar para impulsar mejoras significativas”.

Grok, el chatbot clasificado más bajo en la lista de la ADL y dirigido por su propietario multimillonario Elon Musk para ofrecer respuestas “anti-woke” y “políticamente incorrectas”, ha enfrentado críticas considerables por las expresiones de antisemitismo del año pasado, que incluyeron respuestas que autodeclaraban al programa como “MechaHitler”.

Más recientemente, Musk y Grok han sido criticados por funcionarios gubernamentales de todo el mundo que se oponen a una actualización reciente que permitía a los usuarios crear imágenes sexualizadas “deepfake” que despojaban a las personas que aparecían en las imágenes cargadas.

La Unión Europea abrió una investigación esta semana con el objetivo de determinar si la empresa evaluó y mitigó adecuadamente los riesgos asociados con la implementación de las funcionalidades de Grok en X en la UE. Esto incluye los riesgos relacionados con la difusión de contenido ilegal en la UE, como imágenes sexualmente explícitas manipuladas, incluido contenido que pueda constituir material de abuso sexual infantil.

Henna Virkkunen, vicepresidenta ejecutiva de la UE para soberanía tecnológica, seguridad y democracia, denunció el hecho de que Grok pueda utilizarse para la explotación sexual.

“Las falsificaciones sexuales de mujeres y niños son una forma violenta e inaceptable de degradación”, declaró Virkkunen. “Con esta investigación, determinaremos si X cumplió con sus obligaciones legales bajo la Ley de Servicios Digitales (DSA) o si trató los derechos de los ciudadanos europeos, incluidos los de mujeres y niños, como daños colaterales de su servicio”.

El lunes, un grupo bipartidista de 35 fiscales generales envió una carta a xAI exigiendo la desactivación de la función de desvestirse en imágenes.

El fiscal general de Pensilvania, Dave Sunday, encabezó el esfuerzo.

“El momento de garantizar la protección de las personas frente a herramientas poderosas como la IA generativa no es después de que se haya causado un daño. No se debe esperar a un accidente de coche para establecer barreras de seguridad”, declaró Sunday. “Este comportamiento de los usuarios era demasiado predecible y debería haberse abordado antes de su lanzamiento. Las empresas tecnológicas tienen la responsabilidad de garantizar que sus herramientas no se puedan utilizar de forma tan destructiva antes de lanzar su producto”.

Francia también abrió una investigación sobre Grok en noviembre de 2025, a raíz de publicaciones que promovían la negación del Holocausto en lengua francesa, una violación criminal de las estrictas leyes del país contra la promoción de mentiras sobre el asesinato en masa de 6 millones de judíos por parte de los nazis.

Steven Stalinsky, director ejecutivo del Instituto de Investigación de Medios de Comunicación de Oriente Medio (MEMRI), lleva mucho tiempo alertando sobre la amenaza de que los LLM fomenten el antisemitismo y el terrorismo. Advirtió que “más de dos años después, el problema ha empeorado, no mejorado, lo que plantea una cuestión fundamental sobre la confianza”.

Stalinsky afirmó que “las garantías de las empresas de IA por sí solas son insuficientes”.

En respuesta al último informe de la ADL, Danny Barefoot, director senior del Instituto de Calificaciones y Evaluaciones del grupo, dijo en una declaración que “a medida que los sistemas de IA influyen cada vez más en lo que las personas ven, creen y comparten, la rendición de cuentas rigurosa y basada en evidencia ya no es opcional: es esencial”.